Dialogue Generation AI Pioneer Schmidhuber: Reflections After Not Receiving the Turing Award

Truth is like sunlight; although it may be temporarily obscured by dark clouds, it will eventually break through the gloom and shine brightly.

AI Assistant Struggles to Outperform Traditional Media? Musk's New Creation Grok Performs Poorly in Reporting Trump Attack Incident

The artificial intelligence chatbot Grok incorrectly claimed that former President Trump had been assassinated, an incident that highlights the shortcomings of AI systems in handling real-time information and distinguishing fact from fiction. This error has raised doubts about AI reliability, while also reminding people to remain cautious when relying on AI-generated content.

OpenAI releases "final work" on super alignment research: Large and small models compete to improve output readability

Accuracy has slightly decreased

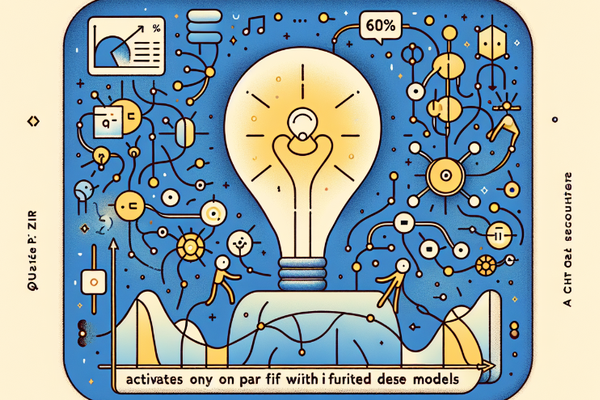

Only activating 3.8B parameters, it performs comparably to similar 7B models, suitable for training and fine-tuning, Microsoft's latest research achievement

Researchers have revealed optimization patterns in the inference process of large language models. Through analysis of models of different scales, they discovered a predictable scaling law that can guide how to perform model inference more efficiently. This finding provides new ideas and methods for optimizing the inference performance of large-scale language models.

Jia Jiaya's team introduces new evaluation criteria: Focusing on large language models' error correction abilities, GPT-4 performs below expectations

Spanning multiple domains, with varying levels of difficulty

Looking globally, seeking entrepreneurial opportunities beyond ByteDance's founder

Technological development is not the key; focusing on the international market is crucial, and profitability is the real priority.

Chinese-American female entrepreneur becomes Stanford tenured professor at 33, creates billion-dollar unicorn company in 3 months, previously advised the White House

Li Fei-Fei founded World Labs, a company that has now surpassed a valuation of $1 billion.