Voix - Texte pour parler

Genspark et autres outils AI Texte pour parler

Découvrez GPT-4o en ligne gratuitement : la plateforme d'IA multimodale avancée d'OpenAI

Découvrez GPT-4o en ligne gratuitement : la plateforme d'IA multimodale avancée d'OpenAIExplorez l'avenir de l'IA avec GPT-4o, la plateforme multimodale révolutionnaire d'OpenAI qui interprète et génère du texte, des visuels et de l'audio. Expérimentez une vitesse, une efficacité coût et une accessibilité inégalées dans la technologie de l'IA. Plongez dans les capacités de GPT-4o et découvrez comment elle peut révolutionner votre interaction avec l'IA. Parfait pour les enthousiastes de la tech, les développeurs et les entreprises visant à améliorer l'efficacité opérationnelle et l'engagement.

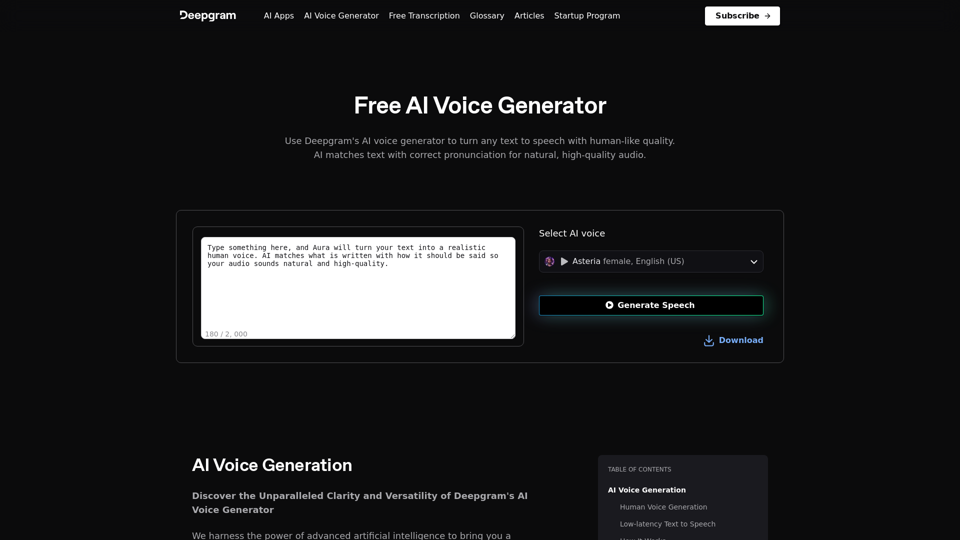

Générateur de voix IA et synthèse vocale | Deepgram

Générateur de voix IA et synthèse vocale | DeepgramDéverrouillez le potentiel du générateur de voix AI de Deepgram. Expérimentez une parole en texte naturel pour tous vos projets.

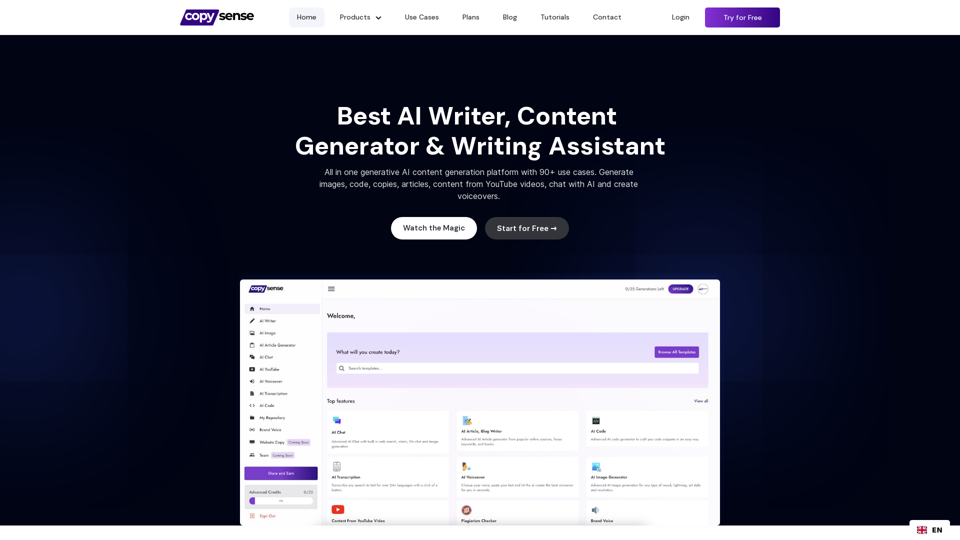

Copysense AI est la plateforme d'IA générative pour créer du contenu précis, sur mesure, avec des données en temps réel, générant des images, des voix off et du contenu à partir de YouTube et d'URL.

Subtitle Sorcier - Reconnaissance vocale en temps réel, traduction de sous-titres par IA

Subtitle Sorcier - Reconnaissance vocale en temps réel, traduction de sous-titres par IARegardez les séries télévisées étrangères, apprenez deux choses à la fois, le génie des sous-titres de traduction vient vous aider, un outil de traduction de sous-titres basé sur le navigateur.

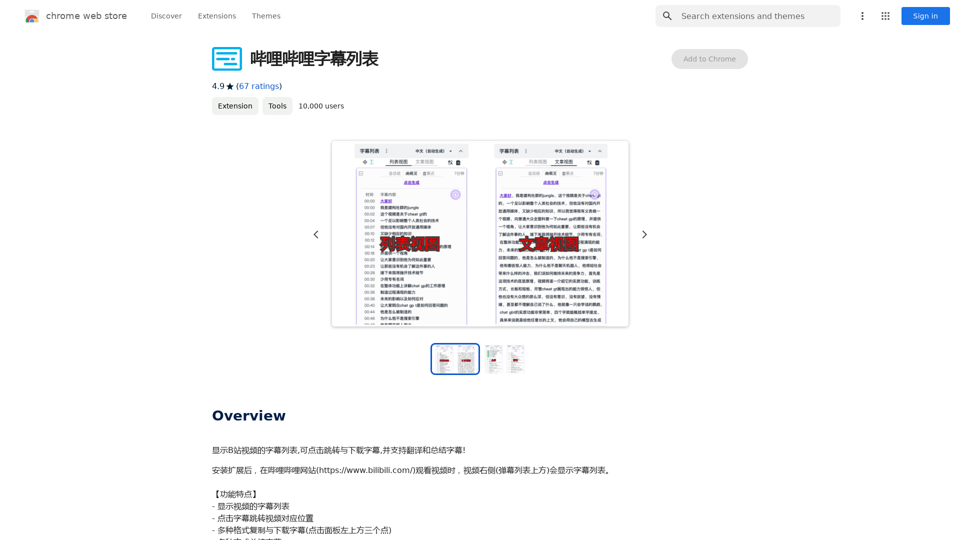

Afficher la liste des sous-titres de la vidéo Bilibili, cliquable pour sauter et télécharger les sous-titres, et prendre en charge la traduction et le résumé des sous-titres !

Prend en charge le moteur de voix anglais pour chatgpt.com, rendant les conversations plus naturelles et les interactions plus fluides.

LocalhostAI - Votre assistant AI pour Chrome et Gemini Nano

LocalhostAI - Votre assistant AI pour Chrome et Gemini NanoLocalhostAI : Votre assistant AI conçu pour fonctionner en parfaite harmonie avec Chrome et Gemini Nano. Améliorez votre productivité avec des modèles d'IA avancés.

Cette extension pour ChatGPT vous permet de poser des questions à l'aide de votre voix et d'écouter la réponse.

La plateforme Audio AI tout-en-un. La solution ultime pour la transcription audio, la reconnaissance vocale, le stylo audio, la synthèse vocale, le doublage vidéo et la légende en direct.

La plateforme Audio AI tout-en-un. La solution ultime pour la transcription audio, la reconnaissance vocale, le stylo audio, la synthèse vocale, le doublage vidéo et la légende en direct.La plateforme Audio AI tout-en-un. La solution ultime pour la transcription audio, la synthèse vocale, le stylet audio, la synthèse vocale, le doublage vidéo et les sous-titres en direct

ChatTTS est un modèle de génération de voix sur GitHub à 2noise/chattts. Chat TTS est spécifiquement conçu pour les scénarios de conversation. Il est idéal pour les applications telles que les tâches de dialogue pour les assistants de langage grand public, ainsi que les introductions audio et vidéo conversationnelles. Le modèle prend en charge à la fois le chinois et l'anglais, démontrant une qualité élevée et une naturalité dans la synthèse vocale. Ce niveau de performance est atteint grâce à une formation sur environ 100 000 heures de données chinoises et anglaises. En outre, l'équipe du projet prévoit de mettre en open-source un modèle de base formé avec 40 000 heures de données, ce qui aidera les communautés académiques et de développeurs à poursuivre les recherches et le développement.